Qué hemos aprendido probando GitHub Copilot para generar tests end‑to‑end

Durante las últimas semanas he estado trabajando en un piloto para validar si GitHub Copilot podía ayudarnos a acelerar la creación de tests end‑to‑end. La pregunta era clara: ¿Puede la IA hacernos más rápidos sin perder calidad?

Después de completar el piloto, la respuesta ha sido sí… siempre que la guiemos bien. Aquí te cuento el proceso, los resultados y también algunos ejemplos reales de los prompts que utilicé en Copilot para que veas cómo trabajamos.

🚀 El punto de partida

Queríamos construir una pequeña base para automatizar pruebas E2E sobre Selenium y xUnit, aplicando buenas prácticas: Page Object, uso de data-testid, estabilidad ante cambios del frontend… Lo hicimos automatizando cinco flujos críticos:

- Búsqueda válida con resultados

- Búsqueda sin resultados

- Validación de entrada

- Creación de cambio correcta

- Creación de cambio con error

Esto constituía nuestro MVP de automatización.

🤖 Cómo usamos Copilot (con ejemplos reales de prompts)

Copilot fue un apoyo durante las fases de diseño y programación, pero nunca intervino en la ejecución real de los tests.

1. Diseño: generar la estructura base de los tests

En el enfoque tradicional, analizar un módulo complejo puede llevar 6–8 horas. Con Copilot, redujimos esta fase a minutos gracias a los prompts adecuados.

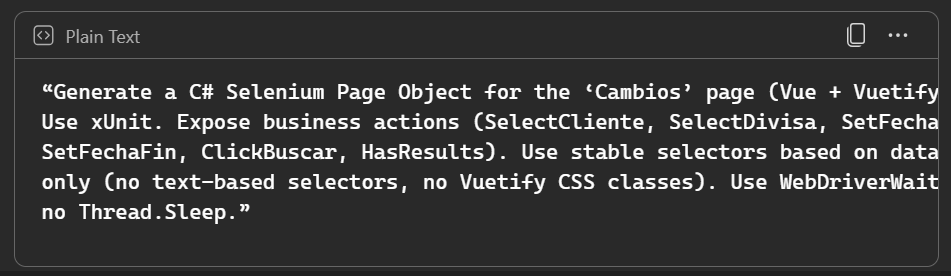

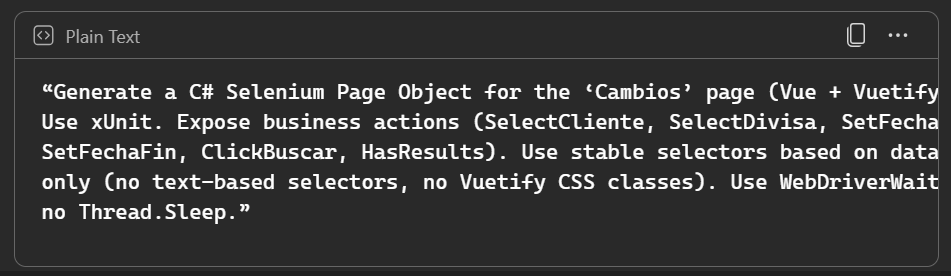

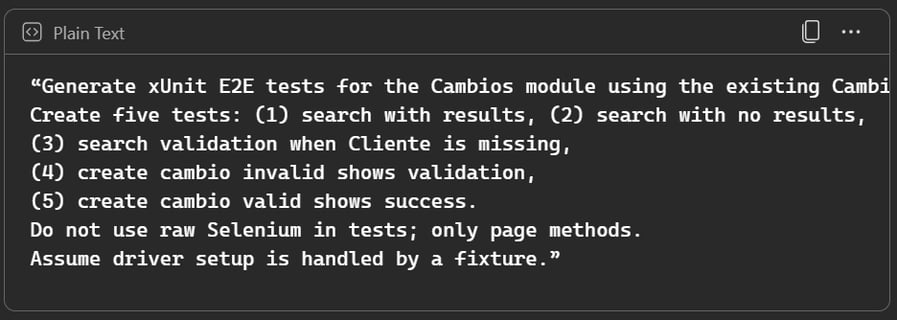

👉 Aquí tienes uno de los prompts que utilicé para generar el Page Object:

El resultado fue un primer borrador del Page Object bastante sólido y alineado con nuestras necesidades. Solo tuve que revisar y ajustar detalles.

2. Programación: acelerar la creación de los tests

Crear manualmente los cinco tests podría llevar unas 5 horas.

Copilot generó la primera versión en 2 minutos.

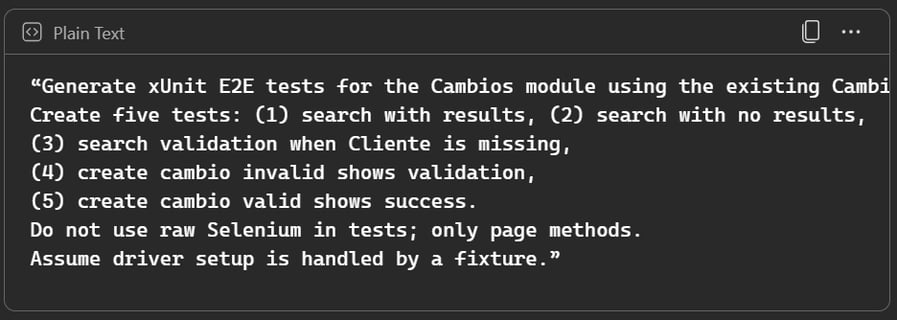

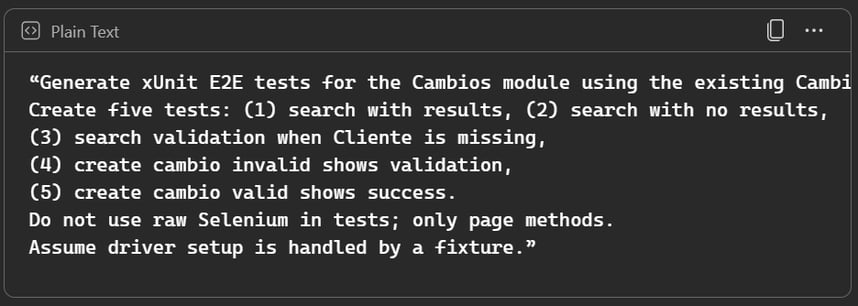

Aquí va otro ejemplo real:

Esto generó una suite inicial muy útil, que después revisé para asegurar que las validaciones y flujos coincidían al 100% con el comportamiento real de la aplicación.

3. Estandarización: mantener una estructura consistente

La IA también nos ayudó a unificar criterios. Por ejemplo, generó propuestas coherentes de data-testid, lo que nos permitió estandarizar todo el módulo.

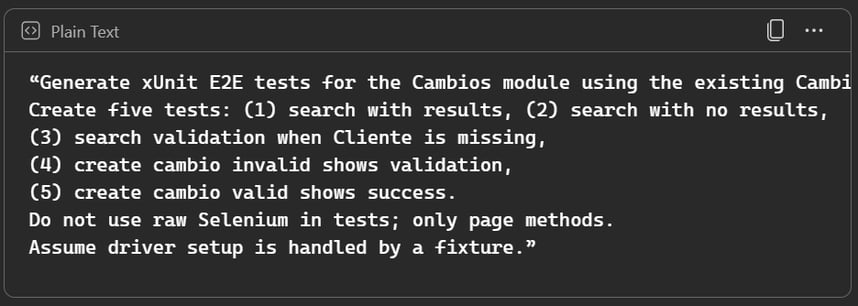

Ejemplo de prompt:

Esta parte fue clave para desacoplar el DOM de los tests y reducir el mantenimiento futuro.

🧠 Lo que aprendimos (y lo que hay que vigilar)

Copilot acelera muchísimo, pero no sustituye la experiencia profesional. Cometió algunos errores habituales:

- Propuso frameworks incorrectos (Cypress, Playwright…)

- Inventó selectores inexistentes

- Asumió flujos que no estaban en la UI

Por eso, el criterio técnico sigue siendo indispensable. La IA no sustituye al desarrollador, pero sí lo impulsa.

📊 El resultado final con Copilot GitHub

La comparación lo dice todo:

| Enfoque |

Tiempo estimado |

| Manual |

13–16 horas |

| Con Copilot |

1–1,5 horas |

Esto supone un ahorro cercano al 90% del tiempo, manteniendo la calidad técnica del framework.

Además, no solo automatizamos cinco casos reales: dejamos construida una base robusta y escalable para extender la automatización en el futuro.

➡️ ¿Quieres ver el estudio completo?

Accede al estudio completo con datos, gráficas, análisis comparativos y recomendaciones accionables para tu organización:

👉 Descargar: Estudio “Productividad Aumentada con GitHub Copilot”